مجتمع التحقق العربي

هو منظمة بحثية غير ربحية معنية بدراسة الأخبار الزائفة والمعلومات المضللة باللغة العربية على الانترنت، وتقديم الحلول الرائدة والمبتكرة لرصدها

دليلك السريع لعملية التحقق من الصور المولدة بالذكاء الاصطناعي

Aug. 12, 2025

تنتشر صور “مبهرة” كل يوم، ولكن الكثير منها ليس حقيقيًا، بل مُنشأ بأدوات الذكاء الاصطناعي أو مُعدَّل رقميًا. هذا دليل عملي، مبسّط وموجّه للمستخدم العادي، لتعرف خلال دقائق طريقة التحقق من الصور المولدة بالذكاء الاصطناعي.

أولًا: قاعدة التمهّل:

إشارات إنذار داخل الصورة:

ابحث عن هذه العلامات الشائعة في الصور، وهي من أهم طرق التحقق من الصور المولدة بالذكاء الاصطناعي:

- اليدين والأصابع: أصابع زائدة أو ملتحمة، أساور تخترق الجلد، أظافر ملخبطة.

- الوجوه والعينان: تناظر مفرط، عيون بزوايا غير طبيعية، أسنان كتلة واحدة.

- الكتابات أو الشعارات: نصوص على اللافتات أو الأزياء مشوّهة أو غير مقروءة.

- الظلال والضوء: اتجاهات إضاءة متناقضة، ظل بلا مصدر.

- التكرار الغريب: تكرار أشجار، ملابس، قطع، لوحات، وتكون متطابقة تمامًا بنمط مُستنسخ.

- الحواف والقماش: حواف “مذابة”، نسيج ملابس يذوب في الخلفية، مجوهرات ملتوية.

- الخلفية: جمهور بلا ملامح، معدات عسكرية بأرقام غير منطقية، ترتيب مسرح الحدث مثالي أكثر من اللازم.

لا تكفي علامة واحدة للحُكم النهائي؛ اجمع أكثر من مؤشر.

افحص “السياق” خارج الصورة

- هوية الحساب: جديد؟ يغيّر اسمه كثيرًا؟ تنبيه.

- مكان النشر: مجهول أم جهة رسمية؟

- الزمان والمكان: هل توجد أخبار أو صور أخرى من نفس الحدث؟ هل تتطابق حالة الطقس، ملابس الناس، أو معالم المكان؟

أدوات سريعة ومجانية (استخدم أكثر من أداة)

| الأداة | ماذا تفعل؟ | الرابط |

|---|---|---|

| Google Lens | بحث عكسي بصري واسع على الويب | https://lens.google.com |

| Bing Visual Search | بحث عكسي بصري بديل | https://www.bing.com/visualsearch |

| TinEye | بحث عكسي للعثور على النسخ الأقدم/الأصل | https://tineye.com |

| Yandex Images | بحث عكسي قوي خاصة للوجوه والمشاهد | https://yandex.com/images |

| FotoForensics (ELA) | تحليل أخطاء الإضاءة/الضغط لاكتشاف الدمج | http://fotoforensics.com |

| Forensically (29a.ch) | حزمة فحوص جنائية (ELA، الضوضاء، النسخ/القص) | https://29a.ch/photo-forensics/ |

| Meta Data 2 Go | قراءة بيانات الميتاداتا للصور | https://www.metadata2go.com |

| AI or Not | كاشف هل الصورة مُولدة بالذكاء الاصطناعي | https://www.aiornot.com |

| Illuminarty | تحليل احتمالية توليد الصورة بالذكاء الاصطناعي | https://illuminarty.ai |

| Hive Moderation Detector | كشف صور/محتوى مولّد أو مُعدّل | https://hivemoderation.com |

| Is It AI? | كاشف بسيط لتمييز الصور المولَّدة بالذكاء الاصطناعي | https://isitai.com |

| Was It AI? | كاشف صور مولدة بالذكاء الاصطناعي | https://wasitai.com |

تذكير مهم: الأدوات التي تكشف الذكاء الاصطناعي تعطي احتمالات وليست أدلة قاطعة. الأفضل دائمًا الجمع بين البحث العكسي، وفحوص الميتاداتا، والتحليل الجنائي والبصري للصورة، ومقارنة السياق الزمني/المكاني مع مصادر موثوقة.

طريقة عمل عمليّة (5 خطوات)

- ثبّت المصدر: ابحث عن “النشر الأول”.

- بحث عكسي: ارفع الصورة على Lens/Bing/Yandex. هل تظهر نسخة أقدم أو سياق مختلف؟

- فحص بصري: طبّق قائمة إشارات الإنذار أعلاه.

- استخدم الأدوات: جرّب الأدوات المذكورة في الجدول أعلاه.

- قارن بالأخبار: هل أكدت وكالات موثوقة (رويترز/AP/وكالات رسمية) الحدث نفسه بصور متعددة؟

إن بقي الشك: لا تُشارك.

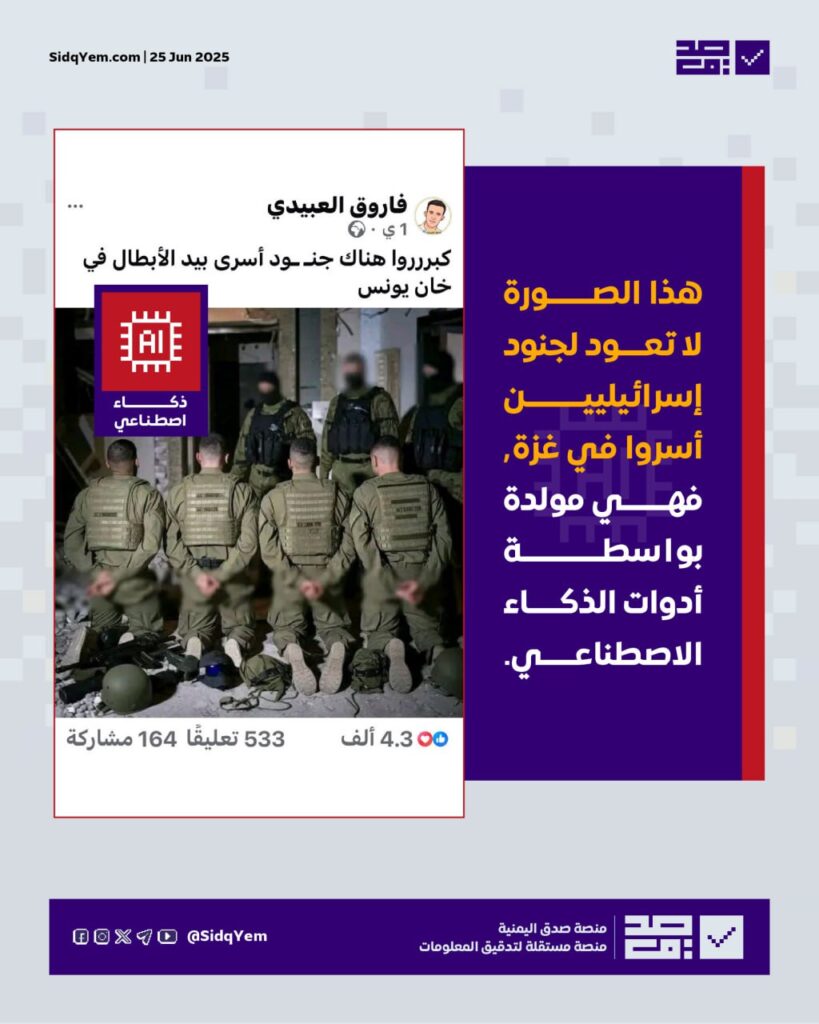

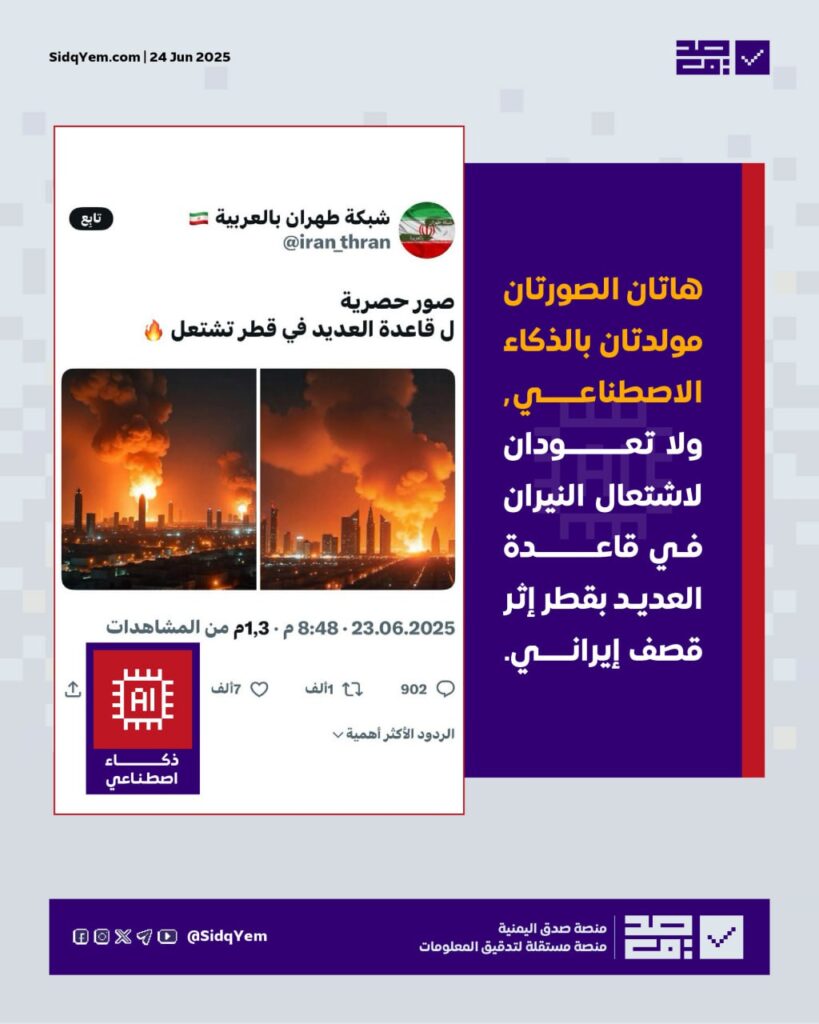

أمثلة من تحقيقات منصة صدق حول محتوى مولد بالذكاء الاصطناعي